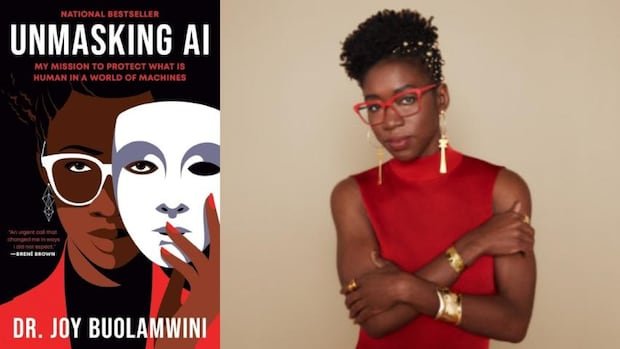

¿Por qué el investigador del MIT pide ‘justicia algorítmica’ contra el sesgo de IA?

Ideas53:59Un rally llorando por ‘justicia algorítmica’ a raíz del ojo

Mantener booquín La investigación de inteligencia artificial está a la vanguardia de la investigación, causando daño a los sistemas de IA por sesgo racial, sesgo de género y eficiencia. Ella es la fundadora de la Liga Algorítmica de la Justicia que trabaja para ser responsable.

«La IA necesita justicia algorítmica para el límite creciente para los derechos civiles. La IA debería ser para las personas y las personas, no solo algunas», escribió Bulamvi.

Su investigación como estudiante de posgrado en el MIT la llevó a llamarla Microsoft, IBM, Amazon y otros gigantes tecnológicos, cuyos sistemas de identidad facial no reconocieron a las personas. Los peores resultados están relacionados con las hembras de piel oscura. Para empeorar las cosas, este software de identificación facial defectuoso ya ha sido utilizado por las corporaciones y las agencias de aplicación de la ley.

Primero encontró los límites de la detección de la cara mientras trabajaba en un proyecto de informática creativa.

«La detección de la cara realmente no reconoció mi cara hasta que llevaba una máscara blanca. Era la hora de Halloween, tenía una máscara blanca alrededor. Tire de la máscara blanca, se encontró la máscara blanca. Retirarla, mi cara más oscura, cara humana, cara original, no encontrada.

Desde entonces, ha dicho que es una abogada seria para corregir el sesgo algorítmico, si no se resuelve.

Aquí hay un resumen de la conferencia de Joy Beaumwini de Rubenstein, que se entregó en la Escuela de Política Pública de Sanford en la Universidad de Duke en febrero de 2025.

«Se muestran las manos. ¿Cuántas personas han escuchado sobre las miradas masculinas?

«A ese diccionario, agregaré una mirada codificada, y esto es realmente un reflejo de la energía. ¿Quién tiene el poder de crear preferencias y preferencias, y a veces, no deliberadamente, sesgada en tecnología?

“Primero me encontré con una mirada codificada como un estudiante de posgrado que trabaja en una instalación de arte …

«Compartí la historia de codificación en una búsqueda blanca en la plataforma TEDX. Mucha gente la ha visto. Así que pensé, ¿qué sabes? La gente puede querer consultar mis argumentos, déjame revisarme».

https://www.youtube.com/watch?v=ug_x_7g63ry

«Tomé mi imagen de perfil de TEDX. Comencé a ejecutar a través de una demostración en línea de diferentes compañías. Encontré algunas compañías que encontré mi cara en absoluto. Y me pregunté si me equivoqué en mi cara u otras personas.

.

«Estoy preocupado por los caminos que aparecen en el mundo del reconocimiento facial en la IA, y lo más importante es ir más allá de los personajes ficticios.

«Afecta a todos por los duplicados incorrectos, no un consenso, e incluso para imágenes claras, especialmente cuando tiene empresas como ClearView AI, no se permite cuando los raspamos con los miles de millones de plataformas de redes sociales.

«Entonces, cuando estamos pensando en dónde estamos en esta etapa del desarrollo de la IA, a menudo pienso en lo que está exodificado, exodificado, negado, culpable, explotado, lo que indica a aquellos que han sido perjudicados por los sistemas de IA».

«Pienso en personas como ocho meses de embarazo porcha Woodruff cuando fue arrestada por tergiversación debido a una identidad equivocada. También informó que tenía contracciones cuando la atrapaban. Estaba enojada con su historia, hace unos años, el mismo departamento de policía Robert Williams fue arrestada frente a sus dos hijos jóvenes y su esposa.

«Por lo tanto, no es un contexto desconocido en EE. UU.

“Otra forma es que tenemos algoritmos de vigilancia.

«Algunos de ustedes, cuando vuelan a casa para vacaciones u otros lugares, comenzó a ver los escaneos de la cara del aeropuerto. Así que la mano de vigilancia se estaba expandiendo.

«Y luego tienes algoritmos de explotación. La celebridad no te protege. La piel leve no te protegerá. Hemos visto con el crecimiento de los sistemas productivos de IA, tenemos la capacidad de crear duplicados profundos, que es un plan dental que nunca escuchará, incluso si nunca ha oído.

DESCARGAR Podcast de ideas Para escuchar el episodio completo.

*Se ha modificado el resumen de claridad y longitud. Este episodio fue construido Sean Fole.